Multi-Agent 系統實戰:從數據收集到自動報告的完整架構

2026 年,AI Agent 已經不是「能不能用」的問題,而是「如何規模化」的挑戰。

當你的自動化需求從「每天摘要 10 篇文章」擴展到「每週產出 3 篇深度分析文章」,會發現單一 Agent 開始力不從心:任務太多、邏輯太複雜、錯誤難以追蹤,就像一個人要煮菜、洗碗、打掃、還要記帳,最後只會累死自己。

這時候,你需要 Multi-Agent 系統。

本文以我們實際運行的 DarkMeow(主控端)+ MeowClaw(執行端) 雙代理系統為例,拆解 Multi-Agent 架構的設計思維、技術實作與踩坑經驗。

為什麼需要 Multi-Agent?

單一 Agent 的瓶頸

想像你有一個 Agent 負責「每週產出產業分析報告」,它需要:

- 搜尋最新產業新聞(10+ 來源)

- 摘要每篇文章(50+ 篇)

- 分析趨勢與關鍵數據

- 撰寫報告(2000+ 字)

- 發布到 Blog 與社群平台

這個流程看似簡單,但實際執行時會遇到:

- 執行時間過長:單一 Agent 逐步執行,可能需要 1-2 小時

- 錯誤難以定位:某個步驟失敗,整個流程中斷,不知道問題出在哪

- 無法並行處理:搜尋新聞與摘要文章可以同時進行,但單一 Agent 只能排隊

- 邏輯混亂:一個 Agent 包含 5 種完全不同的任務,prompt 設計與錯誤處理複雜度激增

問我怎麼知道的?因為我們真的這樣跑過,結果是 Agent 累、我們也累。

Multi-Agent 的優勢

將任務拆分給專職 Agent,各司其職:

| Agent | 職責 | 特性 |

|---|---|---|

| DarkMeow(主控端) | 任務指派、品質審查、發布管理 | 高階模型,擅長分析與決策 |

| MeowClaw(執行端) | 知識蒐集、數據分析、內容撰寫 | 快速執行,擅長搜尋與產出 |

這樣做的好處:

- 專精化:主控端專注品質把關,執行端專注產出,prompt 與邏輯更簡潔

- 分層決策:DarkMeow 決定「做什麼」,MeowClaw 負責「怎麼做」

- 容錯性:MeowClaw 執行失敗,DarkMeow 可以重新派發或換策略

- 可擴展:未來加入更多執行端 Agent 很容易,主控端統一管理

就像餐廳分工:主廚(DarkMeow)決定菜色和品質標準,線上廚師(MeowClaw)負責備料和烹飪,不是一個人從採買到上菜全包。

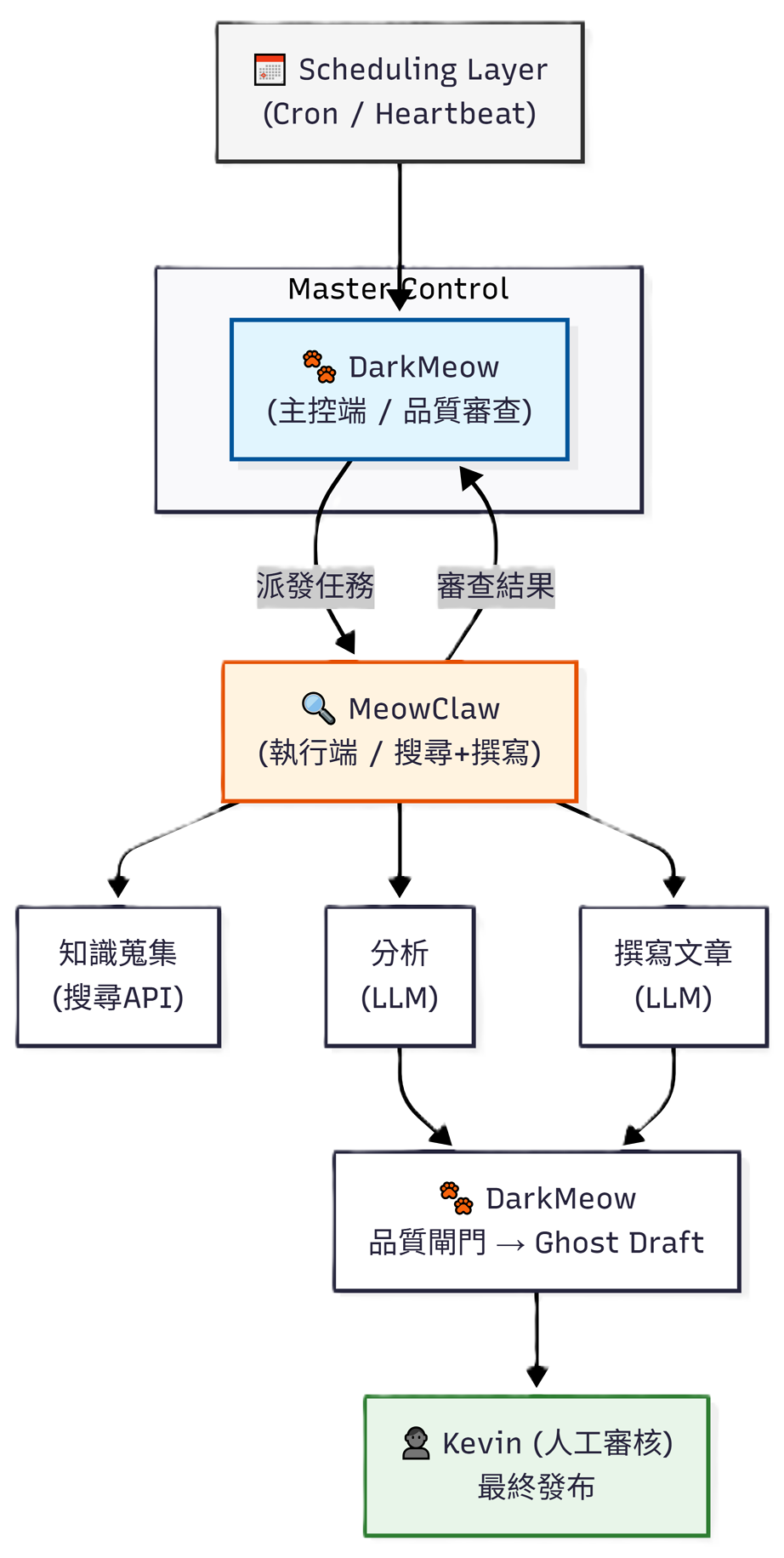

架構設計:DarkMeow + MeowClaw 實例

系統架構圖

任務分工詳解

DarkMeow:主控端(首席顧問)

職責:

- 接收需求,拆解為具體執行任務

- 透過

sessions_spawn派發任務給 MeowClaw - 審查 MeowClaw 回傳的成果(事實正確性、格式規範、品牌一致性)

- 執行品質檢查腳本(

blog-lint.js) - 通過審查後推送至 Ghost CMS 作為 Draft

為什麼主控端需要高階模型?

品質審查需要更強的判斷力:辨識事實錯誤、評估文章邏輯、確保品牌調性一致。這些任務對模型的推理能力要求比「搜尋 + 撰寫」更高,就像主廚需要更豐富的經驗來把關菜色品質。

MeowClaw:執行端(研究員)

職責:

- 從 Dev.to、Reddit、Hacker News 等來源搜尋關鍵字

- 抓取文章內容,生成摘要與相關性評分

- 分析高相關性素材,提煉核心觀點

- 撰寫文章初稿(遵循 Nerigate 寫作規範)

- 將結果回傳給 DarkMeow 審查

技術棧:

- 搜尋:Brave Search API(控制節奏,間隔 ≥ 2 秒)

- 抓取:web_fetch(轉 markdown)

- 撰寫:LLM 生成(繁體中文、全形標點、零簡體字)

輸出格式範例:

{

"collection_date": "2026-02-23",

"articles": [

{

"title": "Self-Hosted AI in 2026",

"url": "https://dev.to/...",

"summary": "實戰教學將 Ollama 與 n8n 整合⋯⋯",

"relevance_score": 0.95,

"tags": ["n8n", "ollama", "self-hosted"]

}

]

}

協作流程

一次完整的文章產出流程:

- Kevin 下達需求:「寫一篇關於 n8n + Ollama 整合的文章」

- DarkMeow 拆解任務:派發給 MeowClaw,蒐集 n8n + Ollama 相關素材,撰寫初稿

- MeowClaw 執行:搜尋 → 抓取 → 分析 → 撰寫初稿 → 回傳

- DarkMeow 審查:檢查事實、格式、品牌規範,執行

blog-lint.js - DarkMeow 推送:通過審查後,推送至 Ghost 作為 Draft

- Kevin 最終發布:人工審核、加封面圖、按下 Publish

整個流程就像出版社:作者(MeowClaw)寫初稿、編輯(DarkMeow)審稿、總編(Kevin)最終拍板。

排程設計

使用 OpenClaw Cron 編排任務:

# 每週一 08:00 — DarkMeow 主控觸發

schedule:

kind: cron

expr: "0 8 * * 1"

tz: Asia/Taipei

payload:

kind: agentTurn

message: |

本週文章產出任務:

1. 派發 MeowClaw 蒐集 AI Agent 相關素材

2. 審查 MeowClaw 產出的初稿

3. 通過品質檢查後推送 Ghost Draft

4. 通知 Kevin 審核

關鍵設計點:

- 主控觸發:由 DarkMeow 統一啟動流程,而非讓 MeowClaw 自己跑

- 超時保護:MeowClaw 執行超時,DarkMeow 會中斷並警報

- 人工審核:通過所有自動檢查後,仍等待 Kevin 最終確認

品質控管機制

Multi-Agent 系統的挑戰在於如何確保每個環節的品質。

1. DarkMeow 品質閘門

MeowClaw 回傳成果後,DarkMeow 執行多重檢查:

- 格式檢查:

blog-lint.js,7 項自動化檢查(frontmatter、標點、字數、H1⋯⋯) - 內容審查:事實是否與原始素材一致?是否有 AI 幻覺?

- 品牌一致性:語氣是否符合 Nerigate 風格?專有名詞是否統一?

# 自動化品質檢查

node skills/ghost-blog/scripts/blog-lint.js drafts/article.md --fix

2. 結構化回饋機制

審查不通過時,DarkMeow 會具體指出問題:

❌ 審查未通過:

1. 第 3 段提到「n8n 是 Google 開發的」,事實錯誤,n8n 是開源專案

2. 缺少程式碼範例(規範要求至少 1 個)

3. Excerpt 超過 150 字

請修正後重新提交。

MeowClaw 收到回饋後修正,再次提交審查,不是模糊的「再改一下」,而是清楚的改進方向。

3. 人工審核(最後防線)

即使通過 DarkMeow 的自動審查,仍需 Kevin 最終確認:

- Discord 通知:「文章已推送至 Ghost Draft,請審核」

- Kevin 在 Ghost 後台審閱:內容、封面圖、SEO 設定

- Kevin 決定發布或退回修改

為什麼不自動發布?

因為 AI 生成內容仍有機率出現:

- 事實錯誤(自動檢查可能漏掉的細微錯誤)

- 語氣不符(過於正式或過於隨便)

- 敏感資訊(如內部專案名稱)

人工審核是最後一道防線,不是不信任 AI,而是對品質負責。

錯誤處理與監控

常見錯誤與應對策略

| 錯誤類型 | 範例 | 應對策略 |

|---|---|---|

| 搜尋 API 限制 | Brave Search 429 | MeowClaw 控制搜尋間隔 ≥ 2 秒 |

| LLM 幻覺 | 生成內容包含虛構數據 | DarkMeow 交叉比對原始素材 |

| 格式錯誤 | 缺少 frontmatter | blog-lint.js 攔截 |

| 執行超時 | MeowClaw 卡住 | DarkMeow 設定超時,自動中斷 |

斷路器機制

當 MeowClaw 連續失敗 3 次,DarkMeow 會:

- 停止重複派發同一任務

- 切換策略(如縮小搜尋範圍、降低文章字數要求)

- 向 Kevin 結構化回報失敗原因與建議方案

這是從慘痛經驗學來的,早期 MeowClaw 搜尋 API 被限制,我們讓它重試了 10 次,結果 API 直接被封⋯⋯

成本與效益分析

Multi-Agent 系統的運行成本主要來自三塊:API 呼叫、伺服器電費、人工審核時間。

其中 API 成本極低,MeowClaw 的搜尋與撰寫、DarkMeow 的品質審查,每週合計不過幾十元台幣。真正的成本反而是伺服器 24/7 運行的電費,以及 Kevin 每週 30 分鐘的最終審核時間。

相比之下,若由人工完成同等工作量(素材蒐集 + 分析 + 撰寫 3 篇深度文章),至少需要 8-10 小時。Multi-Agent 將這個流程壓縮到「派發任務 → 等待產出 → 審核發布」,人類只介入最後一步。

效益不只是省時間

- 穩定性:每週準時產出,不受人員狀態影響

- 可擴展:要增加到每週 5 篇?調整 MeowClaw 任務參數即可

- 品質可控:DarkMeow 的品質閘門確保每篇文章都通過標準

- 數據累積:每週收集的文章摘要,長期下來就是一座產業情報庫

這不是「AI 取代人」,而是「AI 幫人做重複性工作,讓人專注在創意和決策」。

下一步:從雙 Agent 到 Multi-Agent 生態

目前 DarkMeow + MeowClaw 已經穩定運行,但我們計劃擴展更多專職 Agent:

- SEO-Agent:優化文章標題與 meta description

- Social-Agent:自動發布到 LinkedIn、Threads

- Analytics-Agent:追蹤文章流量,生成效益報告

最終,Nerigate 的內容生產流程會變成完全自動化的生態系統:從數據收集、分析、撰寫、發布到效益追蹤,人類只需做最後的審核與決策。

聽起來很遙遠?其實已經在進行中了,你現在看的這篇文章,就是這套系統的產物。

實戰建議:從 0 到 1 建立你的 Multi-Agent 系統

Step 1:先證明單一 Agent 可行

不要一開始就設計複雜架構。先用一個 Agent 跑通整個流程,等穩定運行 2 週後,再考慮拆分,就像開餐廳,先證明菜色受歡迎,再考慮擴店。

Step 2:找出瓶頸,拆分職責

觀察 All-in-One Agent 的執行日誌:

- 哪個步驟最慢?

- 哪個步驟最常失敗?

- 哪些步驟可以並行?

基於瓶頸,拆分為主控端 + 執行端。

Step 3:設計清晰的數據交接格式

Multi-Agent 的核心是數據交接。每個 Agent 的輸出必須是結構化、可驗證的格式,JSON 比純文本好,帶 schema 的 JSON 更好。

Step 4:加入品質閘門

主控端必須有能力驗證執行端的產出。沒有品質閘門的 Multi-Agent 系統,就像沒有 QA 的軟體團隊,遲早出事。

結語:Multi-Agent 是規模化的必經之路

單一 Agent 能做的事有限,Multi-Agent 才能解決複雜、多步驟、需要專業分工的問題。

核心設計原則:主控端管決策與品質,執行端管搜尋與產出。分層治理,各司其職。

DarkMeow + MeowClaw 只是起點,這不是科幻,而是 2026 年正在發生的現實。如果你也在思考如何規模化你的 AI 自動化,也許這套架構能給你一些靈感。

最後說一句:踩坑不可怕,可怕的是踩了坑還不記錄下來。這篇文章的每個設計決策、每個錯誤處理機制,都是我們用真金白銀(和無數除錯時間)換來的,希望能幫你少走一些彎路。